Internal Covariate Shift

- Train Data와 Test Data의 분포의 차이

또한 Train시 한 레이어마다 입력과 출력이 있습니다.

그런데 여기서 한 레이어마다 Internal Covariate Shift가 발생하고 레이어가 많을수록 더욱 심해집니다.

BatchNormalization

Internal Covariate Shift를 해결해주기 위해 BatchNormalization을 사용합니다.

여기서, 주목할 것은 Training 파라미터가 추가가 된다는 것입니다.

※ Bias는 Beta로 대체됩니다!

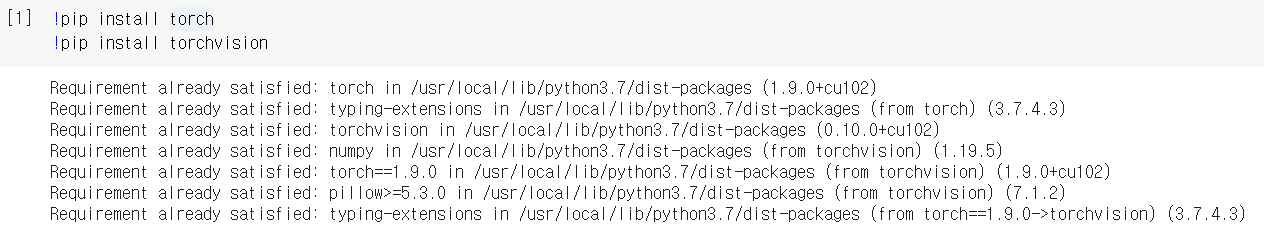

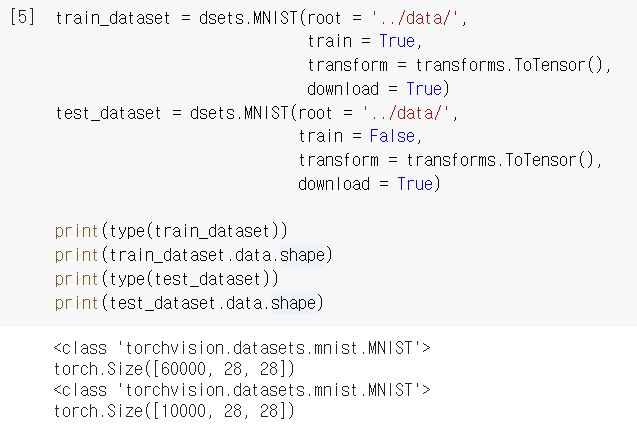

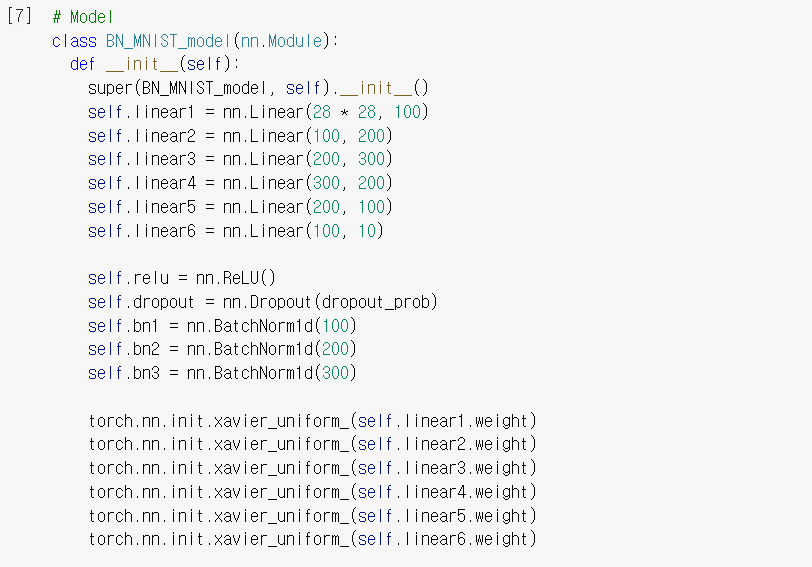

Code

출처:

https://www.youtube.com/watch?v=m61OSJfxL0U&t=100s

https://www.youtube.com/watch?v=HCEr5f-LfVE&list=PLQ28Nx3M4JrhkqBVIXg-i5_CVVoS1UzAv&index=17

'Deep Learning > Pytorch' 카테고리의 다른 글

| 18_Pytorch_CNN_MNIST (0) | 2021.09.30 |

|---|---|

| 17_Pytorch_CNN (Convolutional_Neural_Network) (0) | 2021.09.30 |

| 15_Pytorch_Overfitting_Dropout (0) | 2021.09.14 |

| 14_Pytorch_Weight Initialization (0) | 2021.09.09 |

| 13_Pytorch_Activation_Gradient Vanishing (0) | 2021.09.08 |