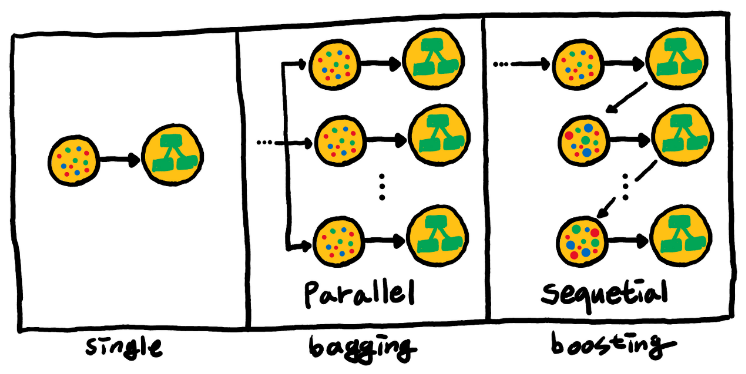

학습 방법

Bagging 방법은 각각의 모델을 독립적으로 학습 시킵니다.

하지만 Boosting은 이전 모델의 학습 결과를 통해 더욱 개선된 모델을 만듭니다.

이전 모델의 학습 결과를 통해 영향을 주는 방법은

분류가 어려운 사례를 강조하기 위해 잘못 분류한 데이터에 가중치를 주어 더 잘 학습하도록 만듭니다.

즉, 잘못 분류한 데이터일수록 샘플링 될 확률이 늘어나게 됩니다.

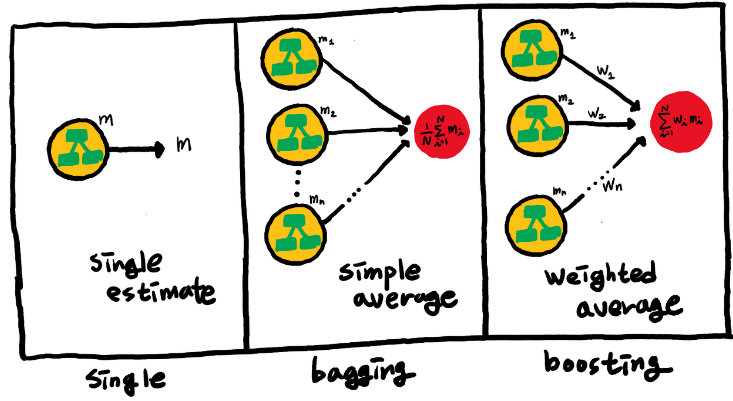

결과 도출 방법

- Bagging

- 각각의 Tree를 정직하게 평균을 내서 사용

- 일반적으로 알고 있는 Soft Voting, Hard Voting 방법 사용

- Boosting

- 각각의 Tree의 학습 결과에 따른 Weight(가중치)를 부여

- 더 잘 학습한 Tree 일수록 더 많은 Weight(가중치)를 주어서 결과를 도출

- 더 좋은 성능을 낼 수 있지만 Over Fitting의 위험이 있다.